读到一则消息,聚焦于三个能看见未来的人,并作出预测,永生不是梦。假如我们能熬过未来的5-10年,我们就可能活到150岁!

第一个人是雷·库兹韦尔(Ray Kurzweil),提出两个主要预测——2029年实现AGI和未来5-10年抗衰老技术爆发。其中预测,未来5到10年,抗衰老技能够帮助人们活到150岁。

雷·库兹韦尔是一位美国发明家、未来学家、作家和企业家,以其对技术发展和人类未来的大胆预测而闻名。他是科技界极具影响力的“预言家”之一,被称为“人工智能之父”之一,也被《华尔街日报》誉为“机器的托马斯·爱迪生”。

他是技术奇点(Technological Singularity)理论的主要倡导者之一,认为人工智能(AI)、纳米技术和其他技术的指数级发展将深刻改变人类社会。他提出:技术进步将使人类“活得足够久”,等到更先进的技术(纳米机器人)完全成熟,从而形成“长寿逃逸速度”(Longevity Escape Velocity),即每年技术进步带来的寿命延长超过一年的自然衰老。

目前的一些AI们(Grok和ChatGPT)认为,库兹韦尔的预测为我们提供了思考未来的框架,但实现这些目标可能需要更长的时间和更多的突破。他的乐观主义激励了技术创新,但也需要谨慎对待其时间表。未来10年,我们可能看到AI和生物技术的重大进展,但“奇点”或“150岁寿命”可能仍需更长时间的努力。

第二位是戴密斯·哈萨比斯(Demis Hassabis),他预测未来10年,人类将治愈几乎所有的疾病,寿命将达到150岁。

这位哈萨比斯是一位英国人工智能(AI)研究员、企业家和神经科学家,现任谷歌DeepMind首席执行官及联合创始人。他因在AI领域的突破性贡献,特别是在蛋白质结构预测方面的工作,与他人共同获得2024年诺贝尔化学奖。

哈萨比斯的预测与库兹韦尔关于抗衰老技术和寿命延长的观点有相似之处,但哈萨比斯的预测更多基于AI在生物医学领域的具体应用。哈萨比斯曾预测AI将在2020年代解决诺贝尔级问题(如蛋白质折叠),这一目标已在2024年实现,增强了他预测的可信度。

但是有些AI们(Grok和ChatGPT)的看法是,将人类寿命延长至150岁在10年内极具挑战性。科技可能推动抗衰老领域取得突破,如优化基因疗法或开发新型抗衰老药物,但150岁的目标需要跨越生物学、技术和社会的多重障碍。更现实的预期是,未来10-20年,AI将显著延长健康寿命,让人们在70-90岁时保持更健康的生活质量。

最后一位是凯文·凯利(Kevin Kelly)。他写了一本新书“2049——未来10000天的可能”,预测未来25年的变革。其中也讲到基因技术和AI的融合,将让健康管理进入定制化,开启“百岁人生”时代。

凯利是美国著名的科技思想家、未来学家、作家和《连线》(Wired)杂志的创始主编,被誉为“硅谷精神之父”和“互联网文化教父”。他以对技术趋势的深刻洞察和前瞻性预测而闻名,其作品深刻影响了科技界对未来的思考。

凯利的预测基于对“技术体”(technium)的理解,即技术作为一个整体系统的演化规律。他擅长通过历史趋势和当前技术轨迹,推演出未来的可能性。他的预测属于“场景规划”(scenario planning),描绘多种可能未来,鼓励人们积极塑造技术方向。

凯利在书中提出五大核心概念(镜像世界、类人智能、AI助理、相互可见、内容爆炸),并列出85-100项具体预测,涵盖技术、社会和生活。这些概念是基于对科技发展趋势的深刻观察,配合丰富想象力对未来所作的展望。

书中对AI与基因技术融合推进“健康定制化”乃至“百岁人生”的阐释,颇具启发性,但仍应与实际医疗伦理、科技监管、社会公平等因素结合来看,避免过度理想化。

综上所述,这些看法和预测,无论能否实现,或者不管什么时候实现,都是为我们人类提供了一种看清未来的视角。

我个人感觉,局限于当下的认知,说人类永生是一种奢谈,但是益寿延年则是有事实根据的。唐代诗人杜甫写道:

朝回日日典春衣,

每日江头尽醉归。

酒债寻常行处有,

人生七十古来稀。

而今天,我居住的瓦蓝湖社区,七十和八十比比皆是。周围的人们,已经让我看到百岁寿命的现实性。现时的情况是“人过八十不稀奇,九十百岁均可期”。因而,随着时代的发展和科技的进步,这些专家和学者们的预言,至少让我感觉到,如果在坚持活个10年,也许我的人生百岁也是有希望的。

往时今日

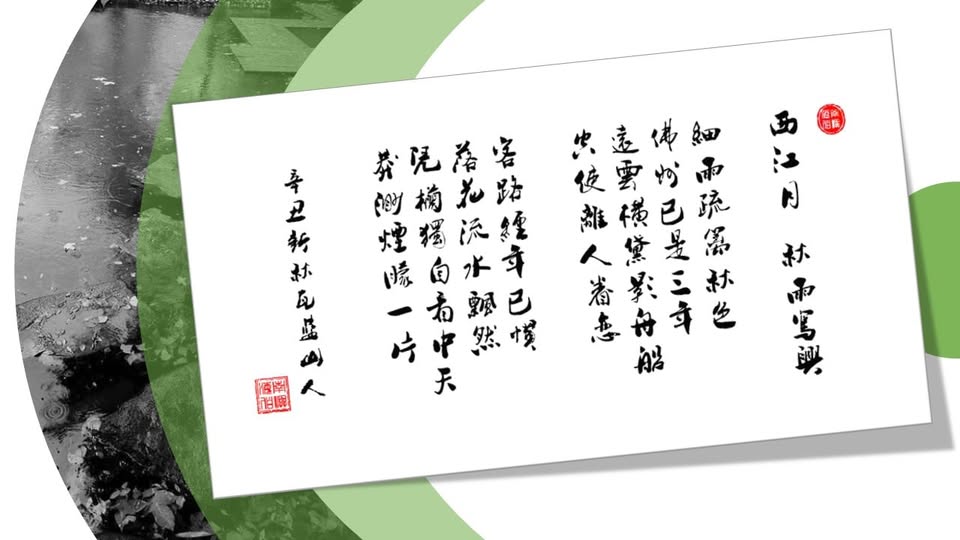

四年前今日,曾经习作一首《西江月·秋雨寫興》。不觉已经在佛州读过七年。

細雨疏籬秋色

佛州已是三年

遠雲橫黛影舟船

空使離人眷戀

客路經年已慣

落花流水飄然

凴欄獨自看中天

莽渺煙濛一片

08/30/2025 周六